目标检测器可以识别给定图像或视频流中可能存在的已知对象集中的哪些对象,并提供有关其在图像中的位置的信息。目标检测器经过训练,可以检测多个类别对象的出现和位置。例如,一个模型可能经过训练,使用包含各种水果的图像,以及指定其代表的水果类别的标签(例如,苹果、香蕉或草莓),以及数据,指定每个对象出现在图像中的位置。有关目标检测器的更多信息,请参阅 目标检测介绍。

使用任务库 ObjectDetector API 将自定义目标检测器或预训练的目标检测器部署到您的移动应用程序中。

ObjectDetector API 的主要功能

输入图像处理,包括旋转、调整大小和颜色空间转换。

标签图区域设置。

用于过滤结果的得分阈值。

前 k 个检测结果。

标签允许列表和拒绝列表。

支持的目标检测器模型

以下模型保证与 ObjectDetector API 兼容。

TensorFlow Hub 上的 预训练目标检测模型。

由 AutoML Vision Edge 对象检测 创建的模型。

满足 模型兼容性要求 的自定义模型。

在 Java 中运行推理

有关如何在 Android 应用程序中使用 ObjectDetector 的示例,请参阅 目标检测参考应用程序。

步骤 1:导入 Gradle 依赖项和其他设置

将 .tflite 模型文件复制到将运行模型的 Android 模块的 assets 目录中。指定该文件不应压缩,并将 TensorFlow Lite 库添加到模块的 build.gradle 文件中

android {

// Other settings

// Specify tflite file should not be compressed for the app apk

aaptOptions {

noCompress "tflite"

}

}

dependencies {

// Other dependencies

// Import the Task Vision Library dependency (NNAPI is included)

implementation 'org.tensorflow:tensorflow-lite-task-vision'

// Import the GPU delegate plugin Library for GPU inference

implementation 'org.tensorflow:tensorflow-lite-gpu-delegate-plugin'

}

步骤 2:使用模型

// Initialization

ObjectDetectorOptions options =

ObjectDetectorOptions.builder()

.setBaseOptions(BaseOptions.builder().useGpu().build())

.setMaxResults(1)

.build();

ObjectDetector objectDetector =

ObjectDetector.createFromFileAndOptions(

context, modelFile, options);

// Run inference

List<Detection> results = objectDetector.detect(image);

有关配置 ObjectDetector 的更多选项,请参阅 源代码和 javadoc。

在 iOS 中运行推理

步骤 1:安装依赖项

任务库支持使用 CocoaPods 进行安装。确保您的系统上已安装 CocoaPods。有关说明,请参阅 CocoaPods 安装指南。

有关将 pod 添加到 Xcode 项目的详细信息,请参阅 CocoaPods 指南。

在 Podfile 中添加 TensorFlowLiteTaskVision pod。

target 'MyAppWithTaskAPI' do

use_frameworks!

pod 'TensorFlowLiteTaskVision'

end

确保您将用于推理的 .tflite 模型存在于您的应用程序包中。

步骤 2:使用模型

Swift

// Imports

import TensorFlowLiteTaskVision

// Initialization

guard let modelPath = Bundle.main.path(forResource: "ssd_mobilenet_v1",

ofType: "tflite") else { return }

let options = ObjectDetectorOptions(modelPath: modelPath)

// Configure any additional options:

// options.classificationOptions.maxResults = 3

let detector = try ObjectDetector.detector(options: options)

// Convert the input image to MLImage.

// There are other sources for MLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

guard let image = UIImage (named: "cats_and_dogs.jpg"), let mlImage = MLImage(image: image) else { return }

// Run inference

let detectionResult = try detector.detect(mlImage: mlImage)

Objective C

// Imports

#import <TensorFlowLiteTaskVision/TensorFlowLiteTaskVision.h>

// Initialization

NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"ssd_mobilenet_v1" ofType:@"tflite"];

TFLObjectDetectorOptions *options = [[TFLObjectDetectorOptions alloc] initWithModelPath:modelPath];

// Configure any additional options:

// options.classificationOptions.maxResults = 3;

TFLObjectDetector *detector = [TFLObjectDetector objectDetectorWithOptions:options

error:nil];

// Convert the input image to MLImage.

UIImage *image = [UIImage imageNamed:@"dogs.jpg"];

// There are other sources for GMLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

GMLImage *gmlImage = [[GMLImage alloc] initWithImage:image];

// Run inference

TFLDetectionResult *detectionResult = [detector detectWithGMLImage:gmlImage error:nil];

有关配置 TFLObjectDetector 的更多选项,请参阅 源代码。

在 Python 中运行推理

步骤 1:安装 pip 包

pip install tflite-support

步骤 2:使用模型

# Imports

from tflite_support.task import vision

from tflite_support.task import core

from tflite_support.task import processor

# Initialization

base_options = core.BaseOptions(file_name=model_path)

detection_options = processor.DetectionOptions(max_results=2)

options = vision.ObjectDetectorOptions(base_options=base_options, detection_options=detection_options)

detector = vision.ObjectDetector.create_from_options(options)

# Alternatively, you can create an object detector in the following manner:

# detector = vision.ObjectDetector.create_from_file(model_path)

# Run inference

image = vision.TensorImage.create_from_file(image_path)

detection_result = detector.detect(image)

有关配置 ObjectDetector 的更多选项,请参阅 源代码。

在 C++ 中运行推理

// Initialization

ObjectDetectorOptions options;

options.mutable_base_options()->mutable_model_file()->set_file_name(model_path);

std::unique_ptr<ObjectDetector> object_detector = ObjectDetector::CreateFromOptions(options).value();

// Create input frame_buffer from your inputs, `image_data` and `image_dimension`.

// See more information here: tensorflow_lite_support/cc/task/vision/utils/frame_buffer_common_utils.h

std::unique_ptr<FrameBuffer> frame_buffer = CreateFromRgbRawBuffer(

image_data, image_dimension);

// Run inference

const DetectionResult result = object_detector->Detect(*frame_buffer).value();

有关配置 ObjectDetector 的更多选项,请参阅 源代码。

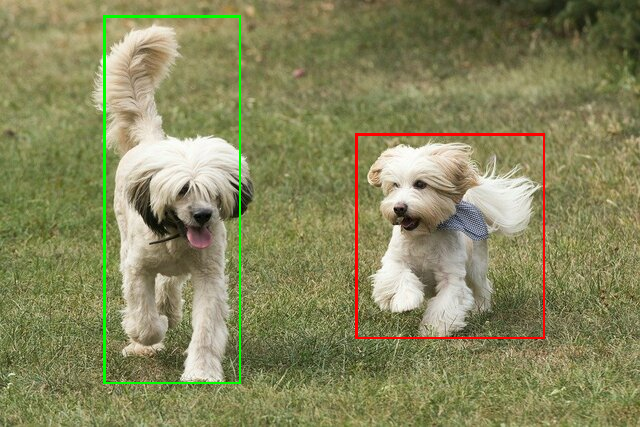

示例结果

以下是如何使用 TensorFlow Hub 上的 ssd mobilenet v1 进行检测结果的示例。

Results:

Detection #0 (red):

Box: (x: 355, y: 133, w: 190, h: 206)

Top-1 class:

index : 17

score : 0.73828

class name : dog

Detection #1 (green):

Box: (x: 103, y: 15, w: 138, h: 369)

Top-1 class:

index : 17

score : 0.73047

class name : dog

将边界框渲染到输入图像上

使用您自己的模型和测试数据尝试使用简单的 ObjectDetector 的 CLI 演示工具。

模型兼容性要求

ObjectDetector API 预计 TFLite 模型具有强制性的 TFLite 模型元数据。有关使用 TensorFlow Lite 元数据写入器 API 为目标检测器创建元数据的示例,请参阅。

兼容的目标检测器模型应满足以下要求

输入图像张量: (kTfLiteUInt8/kTfLiteFloat32)

- 大小为

[batch x height x width x channels]的图像输入。 - 不支持批次推断(

batch必须为 1)。 - 仅支持 RGB 输入(

channels必须为 3)。 - 如果类型为 kTfLiteFloat32,则需要将 NormalizationOptions 附加到元数据以进行输入规范化。

- 大小为

输出张量必须是

DetectionPostProcess操作的 4 个输出,即- 位置张量 (kTfLiteFloat32)

- 大小为

[1 x num_results x 4]的张量,内部数组表示以 [顶部、左侧、右侧、底部] 形式的边界框。 - 需要将 BoundingBoxProperties 附加到元数据,并且必须指定

type=BOUNDARIES和 `coordinate_type=RATIO。

- 大小为

类别张量 (kTfLiteFloat32)

- 大小为

[1 x num_results]的张量,每个值表示类别的整数索引。 - 可选(但建议)标签映射可以作为 AssociatedFile 附加,类型为 TENSOR_VALUE_LABELS,每行包含一个标签。请参阅 示例标签文件。第一个这样的 AssociatedFile(如果有)用于填充结果的

class_name字段。display_name字段从其语言环境与创建时使用的ObjectDetectorOptions的display_names_locale字段匹配的 AssociatedFile(如果有)中填充(默认情况下为“en”,即英语)。如果这些都没有,则只会填充结果的index字段。

- 大小为

分数张量 (kTfLiteFloat32)

- 大小为

[1 x num_results]的张量,每个值表示检测到的对象的得分。

- 大小为

检测数量张量 (kTfLiteFloat32)

- 整数 num_results 作为大小为

[1]的张量。

- 整数 num_results 作为大小为

- 位置张量 (kTfLiteFloat32)